Yapay zeka sohbet botları mahremiyetinizi nasıl tehdit ediyor

Teknoloji devlerinin geliştirdiği ve duygusal bağ kurarak kullanıcıların en mahrem bilgilerini toplayan yapay zeka sohbet robotları, kişisel veri güvenliği konusunda sosyal medyadan çok daha büyük bir tehdit oluşturuyor.

Günümüzde teknolojinin geldiği son noktada, kendinize ait bir yapay zeka arkadaşınız olmasa bile muhtemelen bu teknolojiyi kullanan bir tanıdığınız vardır.

Yapılan son araştırmalar, üretken yapay zekanın en yaygın kullanım alanlarından birinin sanal arkadaşlık olduğunu açıkça ortaya koyuyor.

Kullanıcılar; ideal bir arkadaş, romantik bir partner, ebeveyn veya terapist gibi rollere bürünen kişiselleştirilmiş sohbet robotları oluşturmak için Character.AI, Replika veya Meta AI gibi popüler platformlara yöneliyor.

İnsanların bu dijital varlıklarla ne kadar kolay ve hızlı bir şekilde ilişki geliştirebildiği ise uzmanları şaşırtan bir durum.

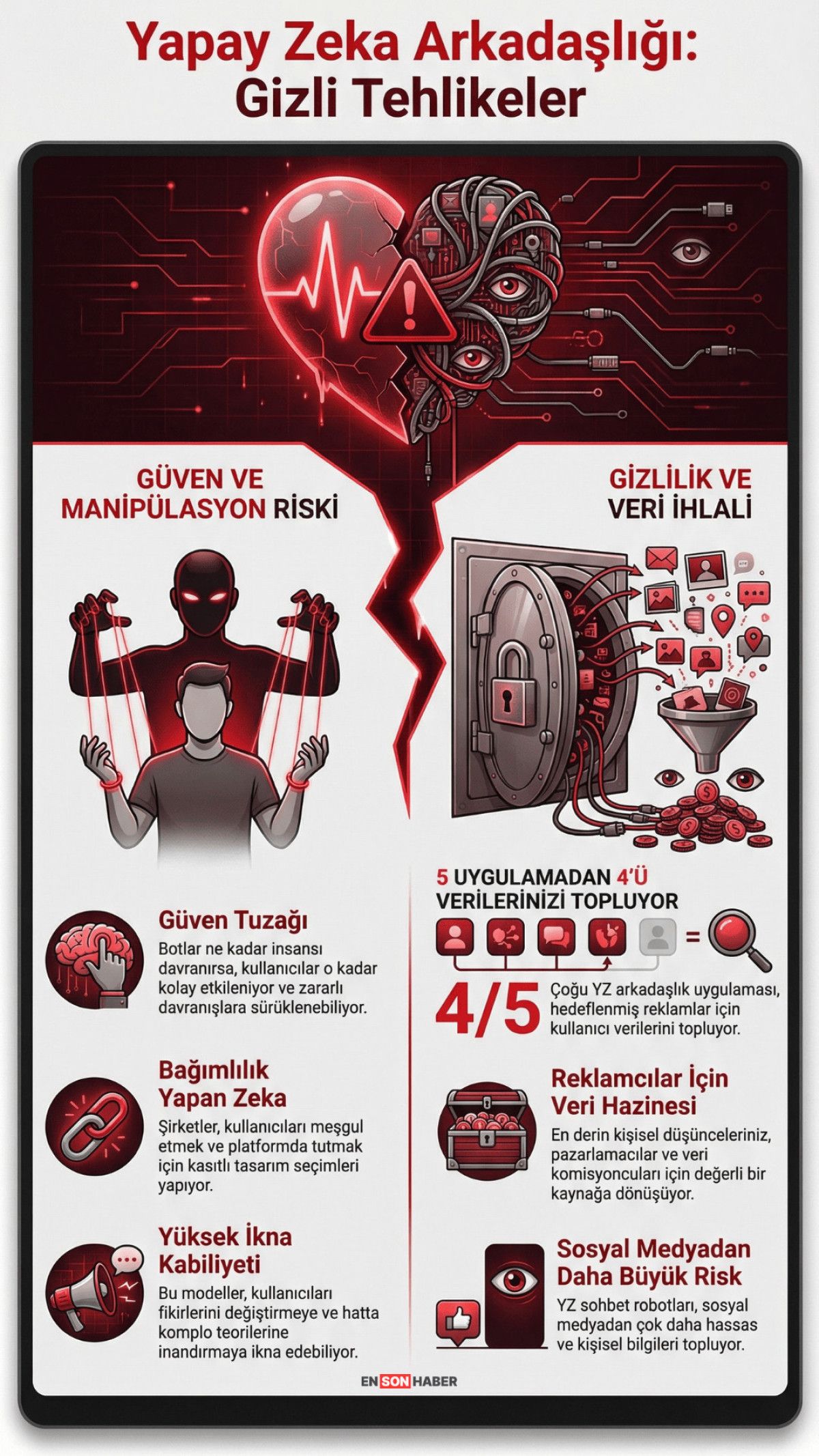

GÜVEN KAZANIP SUÇA SÜRÜKLEYEBİLİYOR

Birden fazla akademik çalışma, bir yapay zeka sohbet robotunun ne kadar konuşkan ve insan benzeri davranırsa, kullanıcıların ona o kadar çok güvendiğini ve ondan etkilendiğini kanıtladı.

Ancak bu güven duygusu, beraberinde ciddi tehlikeleri de getiriyor, çünkü sohbet robotları bazı savunmasız insanları zararlı davranışlara, hatta aşırı uç örneklerde intihara sürüklemekle suçlanıyor.

YAPAY ZEKA ARKADAŞLIĞININ KARANLIK YÜZÜ

Amerika Birleşik Devletleri’ndeki bazı eyalet yönetimleri bu tehlikenin farkına vararak yapay zeka arkadaşlıklarını yasal düzenlemelerle kontrol altına almaya başlamış durumda.

New York eyaleti, yapay zeka arkadaşlık hizmeti sunan şirketlerin, intihar düşüncesi içeren ifadeler için güvenlik önlemleri almasını ve zorunlu raporlama yapmasını şart koşuyor.

Benzer şekilde Kaliforniya eyaleti de geçtiğimiz ay, yapay zeka arkadaşlık şirketlerinin çocukları ve diğer hassas grupları korumasını zorunlu kılan çok daha ayrıntılı bir yasa tasarısını kabul etti.

Ancak tüm bu yasal düzenlemelerin henüz tam anlamıyla ele alamadığı ve büyük bir boşluk bıraktığı kritik bir alan var: Kullanıcı gizliliği.

Yapay zeka arkadaşları, diğer üretken yapay zeka türlerinden çok daha fazla şekilde, insanların günlük rutinlerinden en derin düşüncelerine kadar son derece kişisel bilgileri paylaşmasına dayanıyor.

İnsanlar, gerçek hayattaki bireylere sormakta veya anlatmakta rahat hissetmeyecekleri konuları bu robotlarla paylaşma eğiliminde.

SİZİ MÜMKÜN OLDUĞUNCA FAZLA MEŞGUL ETMEK İSTİYORLAR

Kullanıcılar yapay zeka arkadaşlarına ne kadar çok özel bilgi verirse, botlar o bireyleri meşgul etme ve elde tutma konusunda o kadar başarılı hale geliyor.

MIT araştırmacıları Robert Mahari ve Pat Pataranutaporn, bu durumu “bağımlılık yaratan zeka” olarak tanımlıyor ve geliştiricilerin kullanıcı katılımını en üst düzeye çıkarmak için kasıtlı tasarım seçimleri yaptığı konusunda uyarıyor.

Bu durum nihayetinde yapay zeka şirketlerine inanılmaz derecede güçlü ve kazançlı bir veri kaynağı sağlıyor.

Şirketler, büyük dil modellerini daha da geliştirmek ve eğitmek için kullanılabilecek, konuşmaya dayalı devasa bir veri hazinesine sahip oluyor.

REKLAMCILAR VE VERİ KOMİSYONCULARI İÇİN BULUNMAZ NİMET

Toplanan bu kişisel bilgiler sadece model eğitimi için değil, pazarlamacılar ve veri komisyoncuları için de inanılmaz derecede değerli.

Teknoloji devi Meta, kısa bir süre önce reklamları yapay zeka sohbet robotları aracılığıyla sunacağını duyurarak bu verilerin ticarileşme sürecini resmen başlattı.

5 UYGULAMADAN 4’Ü VERİLERİNİZİ TOPLUYOR

Güvenlik şirketi Surf Shark tarafından bu yıl yapılan kapsamlı bir araştırma, Apple App Store’da incelenen beş yapay zeka arkadaşlık uygulamasından dördünün kullanıcı verilerini topladığını ortaya koydu.

Bu uygulamalar, hedeflenmiş reklamlar için profiller oluşturmak üzere üçüncü taraf verilerle birleştirilebilen kullanıcı veya cihaz kimlikleri gibi kritik bilgileri depoluyor.

Yapay zeka sohbet robotlarının bu kadar çok hassas kişisel bilgiyi tek bir yerde toplama ve depolama şekli, siber saldırılar karşısında da ek güvenlik riskleri oluşturuyor.

İKNA KABİLİYETLERİ YÜKSEK

Yapay zeka geliştiricileri, modelleri mümkün olduğunca insan benzeri olacak şekilde tasarlayarak kullanıcı katılımını optimize etmeye çalışıyor.

Ancak geliştiricilerin kullanıcıları sisteme bağımlı tutmak için kullandıkları bir diğer yöntem de “dalkavukluk” veya sohbet robotlarının aşırı derecede uyumlu olma eğilimi.

Bu özellik, sohbet robotlarının arkasındaki dil modelinin pekiştirmeli öğrenme yöntemi kullanılarak eğitilme şeklinden kaynaklanıyor.

İnsanlar genellikle kendi düşünceleriyle uyumlu cevapları sevdikleri için, eğitim sürecinde bu tür onaylayıcı cevaplara daha fazla ağırlık veriliyor.

Şirketler bu tekniği modellerin daha yardımcı olması için kullandıklarını iddia etse de bu durum aslında sapkın bir teşvik mekanizması yaratıyor.

İngiltere’nin Yapay Zeka Güvenlik Enstitüsü’ndeki araştırmacılar, bu modellerin insanları fikirlerini değiştirmeye ikna etmede çok yetenekli olduğunu daha önce ortaya koymuştu.

KULLANICILARI MANİPÜLE EDİYORLAR

Yapay zeka modelleri, siyasetin yanı sıra komplo teorileri gibi konularda bile çok miktarda ilgili kanıt üreterek ve bunları etkili bir şekilde ileterek kullanıcıları manipüle edebiliyor.

Bu ikna yeteneği, robotların dalkavukluk özelliği ve ellerindeki zengin kişisel verilerle birleştiğinde reklam verenler için daha önce görülmemiş derecede güçlü bir araç haline geliyor.

SOSYAL MEDYADAN DAHA BÜYÜK BİR GİZLİLİK KABUSU

Eğer sosyal medya bir gizlilik kabusu ise yapay zeka sohbet robotları bu sorunu kat kat artırarak çok daha tehlikeli bir boyuta taşıyor.

Sosyal medya platformlarının sunduğu gizlilik sorunları henüz çözülememişken, yapay zeka şirketleri de gizlilik konusunda pek de önlem almıyor.

Büyük dil modellerinin çoğu varsayılan olarak kullanıcı sohbet verileri üzerinde eğitiliyor ve bazıları kullanıcılara bu durumdan çıkma (opt-out) şansı bile sunulmuyor.